Travis CIでfastlaneを使用する

こんにちは。akaimoです。

Travis CIを利用しているiOSプロジェクトにfastlaneを導入して、xcodebuildを直接実行する環境から開放されたので、

備忘録としてやったことを残しておきます。

前提

- CI上でfastlaneを使用

- 複数人で開発

fastlaneのインストール

まずはfastlaneをインストールします。

fastlaneはgemで公開されているのでrubyの環境のバージョンを固定しておきましょう。

CIにインストールされているrubyのバージョンと同じにしておくことをオススメします。

違うとCI上でrubyのインストールが始まってしまうかもしれません。無駄な時間なので素直に同じバージョンを使いましょう。

$ rbenv local 2.4.2

こんどはfastlaneのバージョンを固定するためにbundlerをインストールします。

$ gem install bundler

Gemfileに以下を記述します。

source 'https://rubygems.org' gem 'fastlane'

インストールします。

$ bundle install --path=vendor/bundle

ポイントとしては --path を指定することでローカルの環境を汚すことなくfastlaneをインストールできます。

ここでインストールされたディレクトリはgitで管理する必要はないので.gitignoreに入れておきましょう。

セットアップ

xcodeprojがあるディレクトリでinitコマンドを実行して雛形を作成します。

$ bundle exec fastlane init

実行するとlane(1つのコマンドで実行されるアクションをまとめたもの)を作成するか聞かれます。2か3を選ぶと質問に答えるだけでitunes connectの設定がされるのでオススメです。

完了するとfastlaneというディレクトリが作成されています。

ファイルの中は以下のようになっています。

Fastfile- レーンを記述します。initコマンドで選択したlaneが作成されています。

Appfile- fastlane全体で使用する情報を記載します。initで2か3を選んでいるとapple idやteam idなどが記載されています。

iTunes Connect(TestFlight)へのアップロード

TestFligntへアップロードします。

プロジェクトの設定によって変わりますが、基本は以下のような形です。

lane :beta do build_app( workspace: "Hoge.xcworkspace", scheme: "Hoge", output_directory: "./tmp" ) upload_to_testflight(ipa: "./tmp/Hoge.ipa") end

lanebetaを実行します。

$ bundle exec fastlane beta

initのときに2か3を選択した場合は、initで入力した情報がキーチェーンに保存されているのでローカル環境ではアップロードできますが、

CI上だとapple idのパスワードが存在せず失敗してしまいます。

このような時のためにfastlaneはFASTLANE_PASSWORDという環境変数からパスワードを取得してログインするようになっています。

.travis.ymlで環境変数にパスワードをセットしましょう。

この記事が参考になります。

これでCI上からアップロードできるようになります。

HockeyAppへのアップロード

次はHockeyAppへアップロードします。

HOCKEY_API_TOKEN = ENV['HOCKEY_APP_TOKEN'] PLIST_PATH = "path/to/Info.plist" build = get_info_plist_value(path: PLIST_PATH, key: "CFBundleVersion") version = get_info_plist_value(path: PLIST_PATH, key: "CFBundleShortVersionString") lane :alpha do build_app( workspace: "Hoge.xcworkspace", scheme: "Hoge", configuration: "Adhoc", export_method: "enterprise", output_directory: "./tmp" ) hockey( api_token: HOCKEY_API_TOKEN, bundle_short_version: version, bundle_version: build, ipa: "./tmp/Hoge.ipa", dsym: "./tmp/Hoge.dSYM.zip", ) end

先程と同じようにapiのtokenを環境変数にセットし、それを読み込みます。

TestFlightへのアップロードができていれば、同じようにできるはずです。

Unit Testの実行

せっかくCIの環境があるので、テストも実行しておきましょう。

lane :test do run_tests( workspace: "Hoge.xcworkspace", scheme: "Hoge", configuration: "Debug", device: "iPhone 8" ) end

Slackへの通知

fastlaneにはslackに通知を送る機能があり、自由にカスタマイズでき、好きなタイミングで送ることができます。

今回はアップロードが完了したら通知するようにします。

まずは通知用のlaneを作成します。

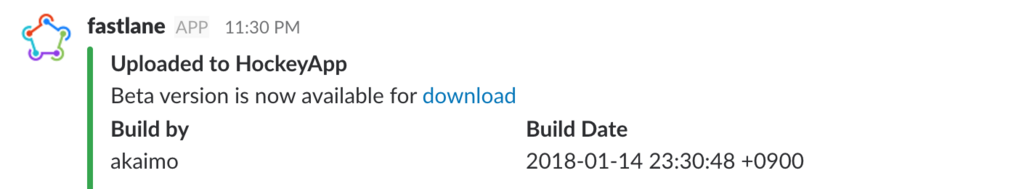

lane :hockey_notification do link = lane_context[SharedValues::HOCKEY_DOWNLOAD_LINK].to_s name = sh("echo $USER") slack( slack_url: "https://hooks.slack.com/services/", channel: "#general", success: true, default_payloads: [], attachment_properties: { title: "Uploaded to HockeyApp", text: "Beta version is now available for <" + link + "|download>.", fields: [ { title: "Build by", value: name, short: true }, { title: "Build Date", value: Time.new.to_s, short: true } ] } ) end

これを実行すると、このような通知がきます。

slackのattachment apiをカバーしているので、公式のドキュメント通りにカスタマイズできます。

これを先程のHockeyAppへアップロードするlaneに追加します。

HOCKEY_API_TOKEN = ENV['HOCKEY_APP_TOKEN'] PLIST_PATH = "path/to/Info.plist" build = get_info_plist_value(path: PLIST_PATH, key: "CFBundleVersion") version = get_info_plist_value(path: PLIST_PATH, key: "CFBundleShortVersionString") lane :alpha do build_app( workspace: "Hoge.xcworkspace", scheme: "Hoge", configuration: "Adhoc", export_method: "enterprise", output_directory: "./tmp" ) hockey( api_token: HOCKEY_API_TOKEN, bundle_short_version: version, bundle_version: build, ipa: "./tmp/Hoge.ipa", dsym: "./tmp/Hoge.dSYM.zip", ) hockey_notification end

alphalaneを実行するとアップロード完了後にslackへ通知がきます。

おわりに

fastlaneを使用してCI上の処理を簡略化しました。

xcodebuildを直接実行していたときと比較すると、

- CIのコードが大幅に減った

- 出力に色が付き整形されるので見やすい

ことがすぐに感じられたメリットです。

Xcodeのバージョンアップによるxcodebuildの変更への追随が、fastlaneの更新だけで済むようになればいいな

と期待しながらCIを拡充していきたいと思います。

ScrollViewとStackViewを組み合わせる

akaimoです。

そろそろiOS8のサポートが終わってきたと思うので、TableViewの変わりにStackViewを使う方法を書きます。

使いにくいScrollView

スクロールが必要な複雑な画面の場合、同じ要素が1つも存在しないのにTableViewを使うことがありました。

ScrollViewではなく、TableViewを使う理由はいくつかありますが、

一番大きな理由はScrollViewを使うためのハマりポイントがたくさんあったからだと思います。

そんなScrollViewですが、StackViewと組み合わせて使うことで大幅に使いやすくなります。

ScrollViewの設定

storyboardとxibを使用して実装します。

storyboard

シンプルにいくために、UIViewControllerを継承したcontrollerを用意します。

このcontrollerをstoryboardで設定していきます。

- このcontrollerにScrollViewを設置し、alignを0で四カ所に制約を付けます。

- ScrollViewの上にStackViewを設置し、こちらもalignを0で四カ所に制約を付けます。

- ScrollViewとStackViewを選択し、Equal Widthの制約を付けます。

これで基本的な設定は完了です。

StackView

StackViewの設定をします。

- AxisをVertical

- AlignmentをFil

- DistributionをEqual Centering

- Spacingを0

view

複数の要素から構成されるので、カスタムviewを使うことをオススメします。

xibを使用してviewを構成します。

viewはいつも通りに作成します。注意するところとしては、このview全体のサイズが決まるように制約を付けることです。

これを守ればあとはStackViewがそのサイズを確保してくれるので、TableViewのように様々なviewを組み合わせてScrollViewを使用することができると思います。

VimにRustの環境を構築する

RustのIntroductionをやってみる途中で、補完とかが効かないとツライなと思ったので

VimにRustの環境を作ってみた。

前提

OSはMacです(たぶんLinuxでも動くと思います)

rustupでRustをインストールしていることを前提とします。

できるようになること

インストール

cargoでRacer(コード補完)とrustfmt(フォーマッタ)をインストールします。

cargo install racer cargo install rustfmt

Vim Plugin

このPluginを使います。

.vimrc

私の設定を乗せておきます。

使用していない機能もあるので、詳しくは各Pluginのドキュメントを参照してください。

NeoBundle 'racer-rust/vim-racer', {'autoload': {'filetypes': ['rust']}} let s:hooks = neobundle#get_hooks("vim-racer") function! s:hooks.on_source(bundle) let g:racer_cmd = "$HOME/.cargo/bin/racer" endfunction NeoBundle 'rust-lang/rust.vim', {'autoload': {'filetypes': ['rust']}} let s:hooks = neobundle#get_hooks("rust.vim") function! s:hooks.on_source(bundle) " save時にオートフォーマットする let g:rustfmt_autosave = 1 let g:rustfmt_command = '$HOME/.cargo/bin/rustfmt' endfunction NeoBundle 'scrooloose/syntastic', {'autoload': {'filetypes': ['rust']}} let s:hooks = neobundle#get_hooks("syntastic") function! s:hooks.on_source(bundle) " save時にシンタックスチェックする let g:syntastic_mode_map = { 'mode': 'passive', 'active_filetypes': ['rust'] } let g:syntastic_rust_checkers = ['rustc', 'cargo'] endfunction

この設定でsave時にオートフォーマットとシンタックスチェックが走ります。

コード補完はC-xC-oでできます。

余談的な

これで結構快適にRustが書けるようになります。

大規模のソースを読むとなると、タグジャンプとかしたくなる。

もう少しRustを書くようならタグジャンプの設定もしようかな。

mackerelでhubotを監視する

raspberry piでhubotを運用していると、いつの間にかhubotが突然死していることがあります。

botが動いてくれないと色々と困るので、先日導入したmackerelで監視して、死亡したらslackにアラートが飛ぶようにします。

観測用のスクリプトを作成

mackerelでカスタムな値を監視するには、自分で監視用のスクリプトを用意する必要があります。

#!/bin/bash

name="process.count.hubot"

monitor_time=`date +%s`

count=`ps aux | grep node | grep hubot | grep -v grep | wc -l`

echo -e "${name}\t${count}\t${monitor_time}"

hubotが生きている = hubotのプロセスが存在する。

と定義して、hubotのプロセス数をmackerelに監視させます。

細かな仕様は以下を参照してください。

ホストのカスタムメトリックを投稿する - Mackerel ヘルプ

mackerel-agent.confに設定

先ほど作成したスクリプトをmackerelに読み込ませます。

mackerel-agent.confに以下のように追記します。

[plugin.metrics.process] command="/hoge/huga/process.sh" type="metric"

Agentの再起動

変更を反映させるために再起動します。

$ sudo service mackerel-agent start

以上でhubotの監視は完成です。

あとは、mackerelでアラートと通知先の設定をするだけです。

Raspberry PI 2にLet's Encryptとnginxでhttps環境を構築

Let's Encryptを使ってhttps環境を構築してみたいと思います。

最新のnginxをインストール

せっかくなので、最新のnginxをインストールしてhttp2にも対応させたいと思います。

基本的には以下の記事を見ればできます。

私の環境では、nginxの設定ファイルは/etc/nginx/conf.d/*****.confとしました。

以下では、この記事ではあまり触れられていないLet's Encryptのセットアップを中心に書いていきます。

Let's Encryptのインストール

まずは、Let's EncryptをGitHubからクローンしてきます。

git clone https://github.com/letsencrypt/letsencrypt cd letsencrypt

証明書の発行

上記の記事ですでにnginxのセットアップは完了しているので、--webrootオプションを使って

サーバーを起動したまま取得します。

./letsencrypt-auto certonly --webroot -d ${DOMAIN} --webroot-path ${WEBROOT}

-dオプションをつけるとマルチドメイン証明書となるので、複数のドメインを指定できます。

${WEBROOT}にはnginxで指定したドキュメントルートを指定します。

成功したら、以下のような出力があります。

IMPORTANT NOTES: - Congratulations! Your certificate and chain have been saved at /etc/letsencrypt/live/******.**/fullchain.pem. Your cert will expire on 2016-**-**. To obtain a new version of the certificate in the future, simply run Let's Encrypt again. - If like Let's Encrypt, please consider supporting our work by: Donating to ISRG / Let's Encrypt: https://letsencrypt.org/donate Donating to EFF: https://eff.org/donate-le

この後、nginx -s reloadでnginxを再起動したらhttpsができるようになっているはずです。

以上で完成です。

ずいぶんお手軽にhttpsが利用できるようになりました。

これを機に個人のwebサーバーもhttpsで運用していきたいところです。

Raspberry PI 2にMackerelを導入して監視してみる

サーバーを監視するツールにMackerelというものがあるらしく、

勉強がてら家で持て余してるRaspberry PI 2に導入してみます。

今回はインストールして、最低限の監視ができるところまでやります。

インストール

Raspberry PI 2で動かすためにはARM版のバイナリが必要になります。

最新版をインストールするために、GitHubにあるリリースページからURLを確認して、wgetでダウンロードします。

wget https://github.com/mackerelio/mackerel-agent/releases/download/v0.30.2/mackerel-agent_linux_arm.tar.gz

次に、展開して/opt下に移動させます。

tar xzf mackerel-agent_linux_arm.tar.gz sudo mv mackerel-agent_linux_arm /opt/mackerel-agent

これでインストールは完了です。

設定

APIキーの設定をします。

APIキーは以下から確認できます。

確認したAPIキーをmackerel-agent.confに追記します。

apikey = "<YOUR_API_KEY>"

起動

起動したら自動的にデータの収集がはじまります。

バックグラウンドで起動したほうがなにかと便利なのでnohupを使って起動します。

nohup ./mackerel-agent --conf=./mackerel-agent.conf &

以上で終わりです。

ここからアラートを設定して運用していきます。

公式が日本語なので、この後はスムーズにできると思います。

デフォルトで用意されている測定項目は最低限のものだけなので、カスタムした内容を測定する方法を次回紹介します。

さくらVPSにdocker-composeでテスト環境を作る

OSは標準のCentOS6.7を使いました。

毎度おきまりの自分用メモに近くなっています。

OSのインストール

契約しただけではOSすら入っていないのでインストールします。

公式のGUIをぽちぽちしていくだけです。

セキュリティの初期設定

http://qiita.com/yu_0105/items/b7cce7a504eed4e31c79を参考に設定しました。

鍵認証の説明だけ少なかったので補足します。

鍵はどこで作成しても問題ありません。

ただ、秘密鍵を転送するのはリスクが大きいのでアクセスするマシンでssh-keygenを実行して、公開鍵をサーバーに転送する方法がベストです。

zshとtmuxのインストールは任意で問題ありません。

使えれば便利なのでインストールすることをおすすめします。

最新のtmuxはhttp://dev.cutecolors.jp.net/install-tmux/を参考に、

zshはhttp://gitpub.hatenablog.com/entry/2013/07/07/182014を参考にインストールします。

gitのインストール

CentOSのgitは古すぎてzshのプラグインとかが動かないので、インストールします。

http://www.task-notes.com/entry/20150622/1434942000を参考にインストールします。

docker関連のツールをインストール

dockerとdocker-composeをインストールします。

dockerのインストール

dockerのインストールにはEPELが必要なのでインストールします。

$ sudo yum -y install http://dl.fedoraproject.org/pub/epel/6/x86_64/epel-release-6-8.noarch.rpm

続いて、dockerをインストールします。

$ sudo yum -y install docker-io $ sudo service docker start $ sudo chkconfig docker on

これでインストール完了です。

docker -hなどを実行してみると、

dial unix /var/run/docker.sock: permission deniedのような警告がでると思います。

rootユーザーで実行するか、sudoをつければ問題ありませんが、

この先、何度もdockerコマンドはうつと思うので、一般ユーザーでもでないようにします。

一般ユーザーでもDockerグループに所属させれば、この警告はでなくなるので、

$ usermod -G docker ユーザ名 $ service docker restart

を実行します。

docker-composeをインストール

docker-composeのインストールは簡単です。

以下を実行します。

$ curl -L https://github.com/docker/compose/releases/download/1.1.0/docker-compose-`uname -s`-`uname -m` > /usr/local/bin/docker-compose $ chmod +x /usr/local/bin/docker-compose

以上で環境構築は完了です。

あとはcloneするなりして、docker-composeを実行するだけです。

やっぱ、LinuxでDockerを使うのは簡単ですね。